はじめに

私が「はやぶさ」搭載用のLIDARを開発していた当時は「ライダー」というと"Rider"と思われてしまった時代でしたが、「はやぶさ2」での開発を経て、最近では新聞やネットニュースで"LiDAR"という単語を頻繁に目にするようになり、隔世の感を覚えます。余談ですが、LIDARは"LIght DetectionAnd Ranging"または"Light Imaging Detection And Ranging"を省略した造語で、一般的には"LiDAR"と表記されていますが、月着陸用レーダーの開発もしてきた私としては「RADAR(レーダー)を"RaDAR"とは書かないだろう」という思いから、LIDARと表記することにしています。

3Dイメージを撮像するLIDAR

LIDARはおおまかに、目標に向けて光を「送る」レーザー、光を「受ける」望遠鏡とセンサー、時間を「測る」ストップウォッチの3つから成っています。光が1ナノ秒で約30 cmの速さで進む性質を使って、LIDARは自ら発射したレーザー光が、目標で散乱して返ってくるまでの往復時間を測ることで距離を計算します。

最近では自動運転車やドローンなどが道路、地面、障害物の形状と位置を知るために3Dイメージ(距離画像)を必要としており、3Dイメージが撮像できるLIDARの実用化が進められています。この3Dイメージでは、距離や空間の分解能(点の数)とともに画面内での時刻ずれがないこと(時刻同時性)が重要になります。動いている探査機や自動車から撮像した際に、画面の左上と右下の距離を測った時間が違うと後の処理がたいへんになるからです。3Dイメージ(距離画像)を撮ることが可能なLIDARにはスキャン型LIDARとフラッシュ型LIDAR(Flash LIDAR)があり、スキャン型は鋭いレーザビームを走査することによって、フラッシュ型はデジタル撮像のように2次元アレイ状のセンサーの視野にレーザーを拡散照射することによって3Dイメージを撮像します。撮像方法の違いから、Flash LIDARには、画面内の時刻ずれがない時刻同時性に優れた3Dイメージが得られ、機械構造がなく簡易な構造であるためシステムの信頼性が高いという特徴があります。

さて、宇宙でも小型月着陸実証機SLIMや月ゲートウェイを拠点とする月の極域探査など、探査機が着陸直前の地形測定、障害物回避、対地姿勢を検出するために3Dイメージが必要となっています。ローバーにおいてもSLAM( SimultaneousLocalization and Mapping)といわれる自己位置推定と環境地図作成のために必要とされますし、軌道上でのランデブードッキングにおいても、相対距離および相対姿勢の測定のために3Dイメージが必要とされています。

このように多くのシーンで必要とされる重要なセンサー技術を、海外に依存せず国内で持つことが、国際的宇宙開発の協力や競争の中で日本が自由度を確保していくことにつながるという思いで、「なんとか Flash LIDAR のコアである3Dイメージセンサーの開発を」と考えていました。「はやぶさ」が帰還した数年後、国内のセンサーメーカーでも開発しているということがわかり、2つ隣のお部屋にいらっしゃったIC設計の専門家の協力を仰いでメーカーとの相談に臨んだのが、私たちの開発のはじまりです。

開発の鍵

Flash LIDARの開発で鍵となるのは3Dイメージセンサーで、光を電流に変えるAPD(Avalanche Photo Diode)のアレイと、その各々に対応する時間測定回路のIC(Integrated Circuit)を、FCB(Flip-Chip Bonding)という技術で貼り合わせた構造をしています。このセンサーでは先に説明したLIDARの機能の中で、光を「受ける」機能と時間を「測る」機能が、集積回路(IC)技術で100μm角以下の画素毎に高密度集積されています。

APDの使い方には、ダイオードの降伏電圧よりも低い逆バイアス電圧で使うリニアモードと、降伏電圧を超えた逆バイアス電圧を加えて使うガイガーモードがあります。リニアモードは出力電流が受信した光に比例して増える特徴がありますが、増倍率M(1光子が生成する電子数)は100程度と感度が低いです。過去に惑星探査機に搭載された長距離LIDARはすべてリニアモードのAPDを使用していますし、OSIRISRExやDragon搭載のFlash LIDARもリニアモードのAPDを使用しています。

これに対してガイガーモードのMは10万以上と高く、光の最小単位である単一光子の検出も可能なほど高い感度を持ちます。このガイガーモードAPDを、単一光子でも検出が可能なことからSPAD(Single Photon Avalanche Diode)と呼びます。SPADの高感度特性は、レーザーを拡散照射するために受信光量が少なくなるFlash LIDARには適していますが、一方で出力電流が受信した光に比例しないため光量の判別ができず、太陽光などの外乱光による光子との識別に工夫が必要です。外乱光への対策として、浜松ホトニクスが独自に開発したマルチピクセルフォトンカウンター(MPPC)という技術があげられます。MPPCは小さなSPADを1画素内に複数個高密度集積したセンサーで、原理的には画素内にあるSPADの個数分のフォトンカウンティングが可能で、光量を判別できます。現状ではシリコン(Si)製しかありませんが、このMPPCを使うと光量が小さい外乱光とレーザーからの信号を識別することができます。

シリコン(Si)を使用したAPDの感度は可視光から1μm程度の近赤外線までですが、技術的難易度が高いインジウムガリウムヒ素(InGaAs)を使うとより波長の長い0.9 ~ 1.7 μmの光をとらえることができます。波長1.4μm以上は目の網膜での吸収が少なく、目に対する傷害が少ないアイセーフ波長域です。したがって、InGaAsが持つ1.4 ~ 1.7μm域の感度は、地上あるいは人がいる環境での使用を考えた場合には安全のために重要な特徴となります。ただし、InGaAsはSiに比べてダークノイズ(入射光が無い状態でのノイズ)が多いことに加えて感度のある面積を広く均質に作ることが難しいため、ノイズが少なく感度の良いAPDの実現には高い技術レベルが必要となります。

開発の今

2015年、宇宙科学研究所は技術的難易度の高いInGaAs製SPADを使った16×16画素の小規模な3Dイメージセンサーを試作し、2016年後半からは宇宙探査イノベーションハブの枠組みで浜松ホトニクスとの共同研究(注)による開発を始めました。月や惑星への着陸機が必要とする障害物検出センサーの基本性能は、最大距離数100m、距離方向分解能10 cm以下、空間分解能50cm以下といわれています。地上用途でも似た仕様の要求があることから、私たちが開発する3Dイメージセンサーの目標は、難易度は高くても人の目に害を及ぼしにくいアイセーフ波長域に感度を持つInGaAs製SPADを使い、128×128画素以上、時間測定回路の分解能は666ps(ピコ秒)以下(距離分解能10 cmに相当)としました。浜松ホトニクスはセンサーの開発と組み立て、JAXAは宇宙応用を見据えた耐放射線性を考慮した回路設計という分担です。

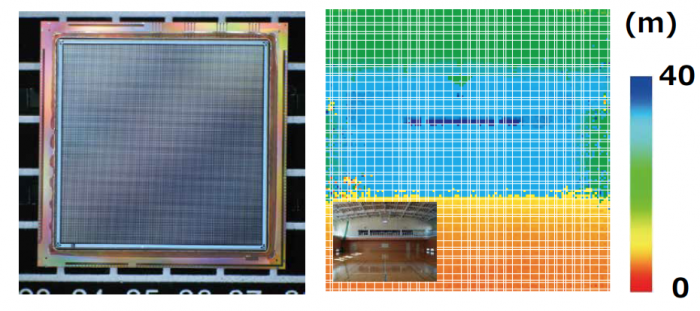

図1 試作された128×128 Si-MPPC 3Dイメージセンサー(左)、体育館を撮像した3Dイメージ(右)。

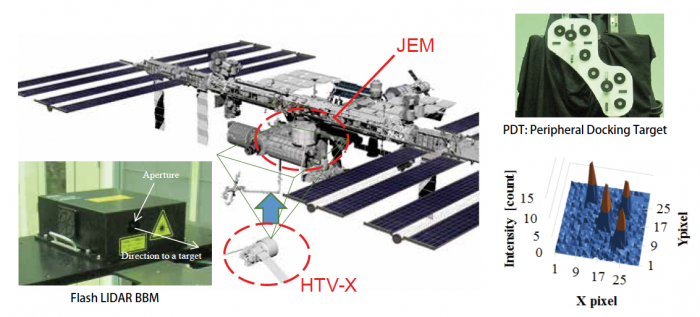

スタートして間もなく、新型宇宙ステーション補給機(HTV-X)のランデブーセンサーとしての用途も加わりました。しかし、InGaAs製SPADはデバイスの開発が始まったばかり、そして要求されるセンサーの視野角と空間分解能は128×128画素では満たせないという高いハードルでした。一方で、浜松ホトニクスは既に単素子の製作技術が確立されているSi製MPPCを使った3 Dイメージセンサーの開発を独自に進めていました。Si製MPPCはフォトンカウンターとしての機能によって強度の測定も可能なことから、外乱光を識別できることに加えて、スタートラッカーのようなセントロイド処理によって画素分解能以上の空間分解能を得られるメリットがあります。そこで、HTV-Xのランデブーセンサーは、浜松ホトニクスが独自開発したSi製MPPCアレイを採用してセントロイド処理で空間分解能の問題を解決することにして、現在3Dイメージセンサーのエンジニアリングモデル(EM)を開発中です。図1は試作段階のSi製MPPCを使った128×128画素の3Dイメージセンサーの写真と、それによって得られた3Dイメージで、30 mほどの体育館の奥行きがきれいに見えているのがわかります。センサーの1画素は100μm角で、この中にさらに12個のサブピクセルのSPADが集積されてMPPCを構成しています。ICはJAXAが耐放射線性を考えた設計で、分解能は距離換算で4 cm以下を達成しています。図2は図1のセンサーの1世代前の32×32画素センサーを使ってJAXA研究開発部門が試作したFlash LIDARで、国際宇宙ステーション側で用意されている接近目標のターゲットPDT(図2右上)を撮影した結果です。この実験の結果、距離測定精度と空間分解能が要求値を満たすことが確認され、画素規模を16倍に拡大した128×128画素の開発へと移行しました。

図2 HTV-X搭向けに試作されたFlash LIDAR(左下)、国際宇宙ステーションに接近するHTV-Xのイメージ(中央)、国際宇宙ステーション側で用意される接近目標となるターゲットPDT(右上)、PDTを撮像した結果(右下)。

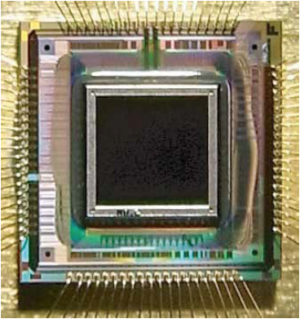

さて、話をアイセーフ波長対応のInGaAs製SPADに戻しますと、宇宙探査イノベーションハブでの共同研究の結果、InGaAs製SPADの低ダークノイズ化や感度の問題が改善されて2018年には図3に示した32×32画素の試作品ができ、現在ではさらに画素規模を拡大した128×128画素の製作が進んでいます。センサーとしての性能は、単一光子から感度があり、感度波長域は0.9 ~ 1.69μm、時間分解能は250ps(距離分解能4cm以下)、測定時間は8μs(最大距離 1.2km)です。さらに画素数を増やすことを念頭に、画素サイズを図1のSi製MPPCタイプの約1/4の面積となる55μm角に納めて製作しています。また、時間測定のためのICは、これまでの重イオンを使った宇宙放射線に対する耐性試験において、ラッチアップと呼ばれるICが破壊に至るようなエラーは発生しないことが確認されています。プロトンやガンマ線を使った放射線試験では、InGaAs製SPADはSi製よりも放射線耐性に優れていることが確認でき、着陸機への搭載に向けて着々と準備を進めています。

図3 試作された32× 32 画素InGaAs-SPAD 3Dイメージセンサー

おわりに

3Dイメージセンサーの研究開発は、宇宙探査イノベーションハブの枠組みの中で多くの方々のご支援とご協力を得て、車載センサーなどの民生応用と宇宙応用がたいへんうまくかみ合い、高いレベルに到達することができました。このセンサーは、ユーザが見たい対象に合わせて送信用のレーザーと受信レンズを選択してFlash LIDARシステムを設計できるため、民生でも宇宙でも多くの用途に利用可能な汎用性の高いセンサーです。宇宙機搭載のためには超えなければならないハードルがいくつか残されていますが、着陸機の障害物検出やランデブーセンサーとしてはもとより、ローバーでの地形認識、地上からのデブリ観測など、私たちが開発した3Dイメージセンサーが多くの分野で活用され、その分野の発展に貢献することを期待しています。

(注)本研究はJSTイノベーションハブ構築支援事業の支援を受けて実施しています。

【 ISASニュース 2020年4月号(No.469) 掲載】